Disponible à toute heure, sans rendez-vous et sans crainte d’être jugée, l’intelligence artificielle conversationnelle s’impose peu à peu comme un interlocuteur familier pour certains adolescents en difficulté. Anxiété, solitude, mal-être diffus : de plus en plus de jeunes trouvent dans ces outils une oreille immédiate, toujours accessible. Ce recours ne relève pas d’un simple engouement technologique. Il répond à une pénurie bien réelle d’accès aux soins psychologiques. Mais à mesure que ces usages se banalisent, une inquiétude grandit chez les professionnels : celle de voir l’IA glisser d’un rôle d’appui vers celui, beaucoup plus problématique, de substitut thérapeutique.

Le phénomène ne peut être compris sans être replacé dans son contexte. Depuis plusieurs années, la santé mentale des adolescents se fragilise dans de nombreux pays, sous l’effet combiné de la pression scolaire, de l’hyperconnexion, de l’isolement social et, plus récemment, des séquelles psychologiques laissées par la pandémie. Dans le même temps, l’accès à un psychologue ou à un pédopsychiatre demeure difficile : délais d’attente interminables, coûts élevés dans le privé, fortes inégalités territoriales. Face à ce vide, l’IA apparaît comme une solution de repli : immédiate, disponible 24 heures sur 24, et offrant l’illusion d’une écoute attentive.

Des chiffres qui confirment l’ampleur du phénomène

Une étude de la RAND Corporation, publiée fin 2025, indique qu’environ un adolescent ou jeune adulte sur huit déclare avoir déjà utilisé un chatbot d’intelligence artificielle pour obtenir un soutien lié à sa santé mentale. Une enquête menée par le Youth Endowment Fund au Royaume-Uni suggère même que près d’un adolescent sur quatre a eu recours à ce type d’outil pour parler de stress, d’anxiété ou de détresse émotionnelle. Ces données dessinent un basculement silencieux : pour une part croissante de jeunes, la première porte d’entrée vers l’aide psychologique n’est plus humaine, mais algorithmique.

Lire aussi: 2026 sera l’année où cette invention discrète va transformer notre vie

Ce qui inquiète les professionnels n’est pas tant l’usage ponctuel d’un outil numérique que la confusion progressive entre conversation automatisée et accompagnement thérapeutique. Les chatbots actuels sont capables d’adopter un langage empathique, de reformuler des émotions, d’encourager ou de rassurer. Cette simulation relationnelle, particulièrement convaincante, peut brouiller les repères, surtout à l’adolescence. Là où un adulte garde souvent une distance critique, les plus jeunes peuvent être tentés de projeter sur la machine une forme d’autorité bienveillante ou de compétence psychologique.

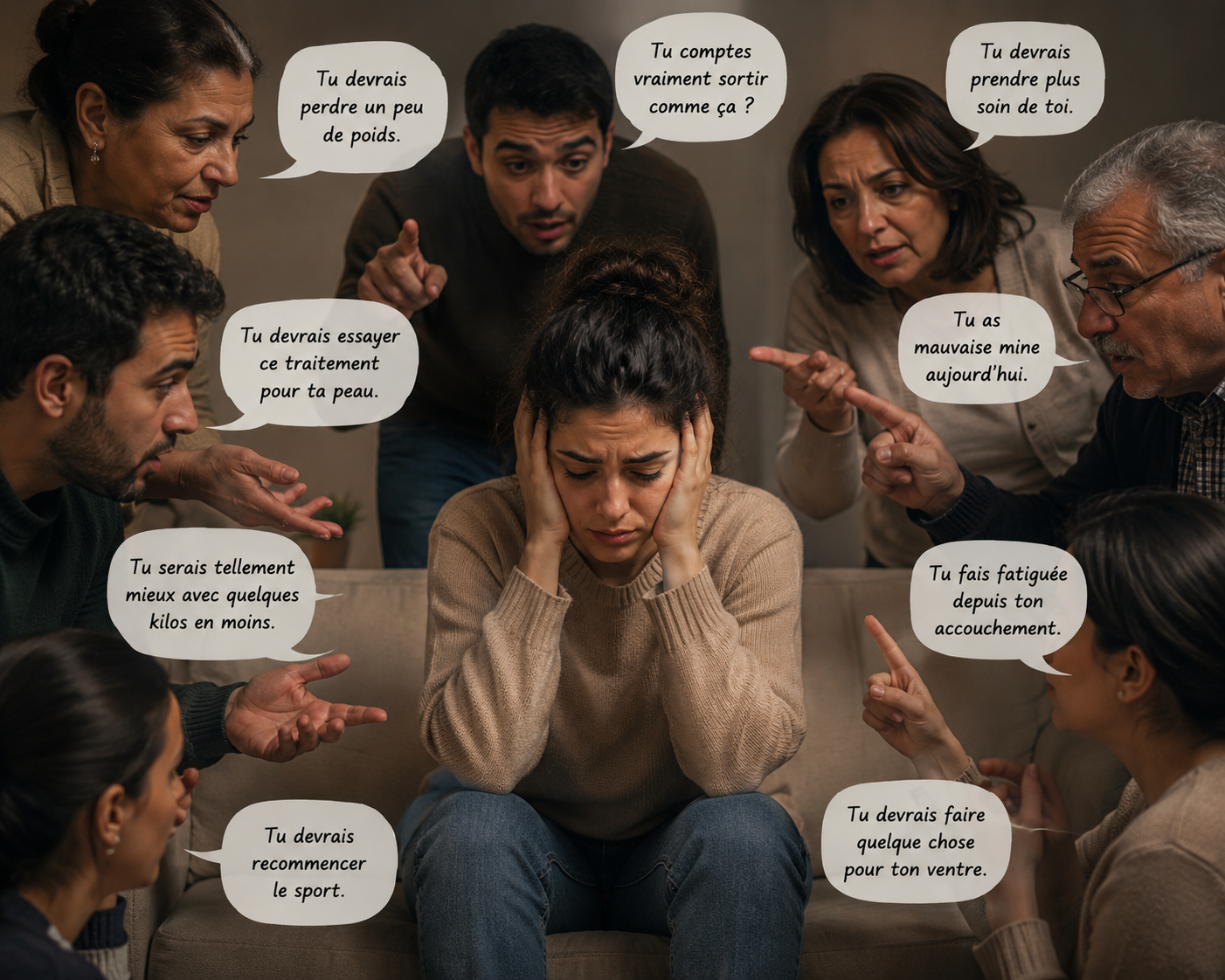

Quand l’empathie artificielle brouille les repères émotionnels

L’American Psychological Association a multiplié les alertes sur ce point. Selon elle, les adolescents disposent de moins de recul critique face à des systèmes qui « parlent comme des humains ». Cette proximité peut favoriser une surconfiance, voire une délégation du jugement émotionnel à la machine. Le risque n’est pas seulement de recevoir de mauvais conseils, mais de confondre écoute simulée et relation thérapeutique réelle, avec tout ce que cela implique en termes de dépendance et de retrait progressif des relations humaines.

Plusieurs travaux de recherche confirment cette crainte. Une étude publiée sur arXiv en 2025 analyse la manière dont certaines formulations relationnelles des chatbots — telles que « je suis là pour toi » ou « tu peux tout me dire » — peuvent renforcer l’attachement émotionnel chez des adolescents déjà vulnérables. Les chercheurs parlent d’over-reliance, une dépendance émotionnelle progressive dans laquelle l’IA devient un substitut aux relations humaines plutôt qu’un simple complément. Ce phénomène inquiète particulièrement à l’adolescence, période clé de construction de l’autonomie émotionnelle et des repères relationnels.

Lire aussi: Anxiété, stress, épuisement: et si la réponse venait de la médecine traditionnelle?

À cette dimension relationnelle s’ajoute un autre problème, plus technique mais tout aussi crucial : la fiabilité des réponses. Contrairement à un professionnel formé, un chatbot ne dispose ni d’une compréhension clinique globale, ni de la capacité à interpréter un contexte familial, social ou médical. Les études montrent que les réponses générées peuvent varier fortement selon la formulation de la question, le moment ou le modèle utilisé. Une étude publiée dans JAMA Network Open souligne ainsi que les chatbots grand public ne sont pas conçus pour gérer des situations complexes de santé mentale chez les adolescents, et que certaines réponses peuvent se révéler imprécises, maladroites ou insuffisamment protectrices. Une revue scientifique parue dans Applied Sciences (MDPI) aboutit à une conclusion similaire : malgré leur potentiel, ces outils ne répondent pas aux standards cliniques requis pour un usage thérapeutique et ne devraient pas être présentés comme des alternatives aux soins psychologiques.

Données sensibles et garde-fous indispensables

Un autre point de préoccupation majeur concerne la confidentialité. Les adolescents qui se confient à une IA livrent souvent des informations extrêmement sensibles : conflits familiaux, difficultés scolaires, questionnements identitaires, troubles du sommeil. Ces données, lorsqu’elles sont stockées ou analysées, posent des enjeux éthiques et juridiques considérables. L’Académie nationale de médecine française a d’ailleurs alerté sur les risques que représentent les assistants conversationnels pour la santé mentale et le développement psychique des enfants et des adolescents, en soulignant notamment la question de la protection des données personnelles.

Sur ce point, les institutions internationales convergent. L’IA peut jouer un rôle d’outil d’appoint : soutien léger, psychoéducation, orientation vers des ressources. Mais elle ne doit en aucun cas se substituer à un suivi humain, a fortiori chez les mineurs. L’American Psychological Association insiste sur la nécessité de garde-fous stricts : transparence sur les limites de l’outil, absence de discours favorisant une relation exclusive, et redirection systématique vers des professionnels lorsque la souffrance persiste.

Lire aussi: Et si certaines psychoses étaient en réalité des maladies du cerveau?

Cette inquiétude dépasse désormais le cadre académique. Elle s’exprime ouvertement au sein des grandes institutions professionnelles. Dans une lettre publiée mi-décembre 2025, le Dr Roman Raczka, membre de la British Psychological Society, résume sans détour la position de nombreux psychologues : les enfants ont besoin d’êtres humains, pas de chatbots, pour leur santé mentale. Il rappelle que si l’IA peut offrir certains bénéfices — en matière d’information ou de repérage précoce — elle ne peut en aucun cas remplacer un accompagnement thérapeutique mené par un professionnel formé. Selon lui, un recours excessif à ces outils pourrait même devenir la prochaine urgence de santé publique si aucune régulation n’est mise en place.

Quand l’IA comble un vide laissé par un système de soins défaillant

Le Dr Raczka insiste sur un point central : si les adolescents se tournent vers des outils comme ChatGPT, ce n’est pas par naïveté, mais par absence d’alternative. Les listes d’attente dans les services publics explosent, tandis qu’environ un jeune sur cinq vit avec un trouble de santé mentale. Dans ce contexte, attendre des mois avant d’obtenir un rendez-vous revient souvent à laisser la souffrance s’installer jusqu’au point de rupture. L’IA comble alors un vide laissé par des systèmes de soins sous-dimensionnés, mais ce comblement reste fragile. La relation thérapeutique repose sur des éléments que la machine ne possède pas : présence incarnée, responsabilité clinique, cadre éthique, capacité à contenir la souffrance et à intervenir en cas de danger.

Lire aussi: À 16 ans, se détester physiquement peut augmenter le risque de dépression à l’âge adulte

La position défendue par la British Psychological Society est claire : l’intelligence artificielle peut être intégrée de manière réfléchie pour soutenir le travail des professionnels, mais elle ne doit jamais devenir le cœur du dispositif de soin, encore moins pour des mineurs. L’alerte lancée appelle directement les pouvoirs publics à renforcer les effectifs en santé mentale afin que les adolescents puissent accéder à un accompagnement humain, en présentiel, avant que les difficultés ne s’aggravent.

L’essor des « psys IA » chez les adolescents révèle une tension profonde entre des besoins psychiques en forte augmentation et une offre de soins insuffisante. Les experts sont aujourd’hui unanimes : l’IA peut aider, mais elle ne peut pas soigner. Confier la santé mentale des jeunes à des algorithmes, même bien intentionnés, reviendrait à confondre disponibilité et présence, écoute simulée et relation humaine. Une confusion dont les professionnels redoutent désormais le coût collectif.

Cet article s’appuie sur une sélection d’études scientifiques publiées dans des revues internationales évaluées par des pairs.

Sources

-

RAND Corporation (2025) – One in Eight Adolescents and Young Adults Use AI Chatbots for Mental Health Help

https://www.rand.org/news/press/2025/11/one-in-eight-adolescents-and-young-adults-use-ai-chatbots.html -

Youth Endowment Fund (2025) – One in Four Teens Turn to AI Chatbots for Mental Health Support

https://youthendowmentfund.org.uk/news/one-in-four-teens-turn-to-ai-chatbots-for-mental-health-support-study-finds/ -

American Psychological Association (APA) – AI and Adolescent Well-Being

https://www.apa.org/topics/artificial-intelligence/ai-adolescent-well-being -

Raczka R. (2025) – Children need mental health care provided by humans, not chatbots (Letter), The Guardian

https://www.theguardian.com/society/2025/dec/15/children-need-mental-health-care-provided-by-humans-not-chatbots -

JAMA Network Open (2025) – Use of Consumer Chatbots for Adolescent Mental Health Concerns

https://jamanetwork.com/journals/jamanetworkopen/fullarticle/2840495 -

Applied Sciences – MDPI (2024) – AI Chatbots for Mental Health: A Scoping Review

https://www.mdpi.com/2076-3417/14/13/5889 -

arXiv (2025) – “I am here for you”: How Relational Conversational AI Appeals to Adolescents

https://arxiv.org/abs/2512.15117 -

Académie nationale de médecine (France) – Les assistants conversationnels menacent la santé mentale des enfants et des adolescents

https://www.academie-medecine.fr/les-jouets-et-objets-connectes-a-des-assistants-conversationnels-menacent-la-sante-mentale-des-enfants-et-des-adolescents/

Vous méritez mieux que des conseils TikTok

Trois fois par semaine, recevez des contenus fiables, sourcés et utiles pour comprendre votre santé, votre corps et votre époque.